يوم الاثنين انثروبي رفعت دعواه ضد وزارة الدفاع بسبب تصنيفها كمخاطر لسلسلة التوريد. وبعد ساعات، حضر ما يقرب من 40 موظفًا من OpenAI وGoogle – بما في ذلك جيف دين، كبير علماء Google وقائد Gemini -. قدم ملخصًا صديقًا لدعم الدعوى القضائية التي رفعتها شركة Anthropic، مع توضيح مخاوفهم بشأن قرار إدارة ترامب ومخاطر التكنولوجيا وآثارها.

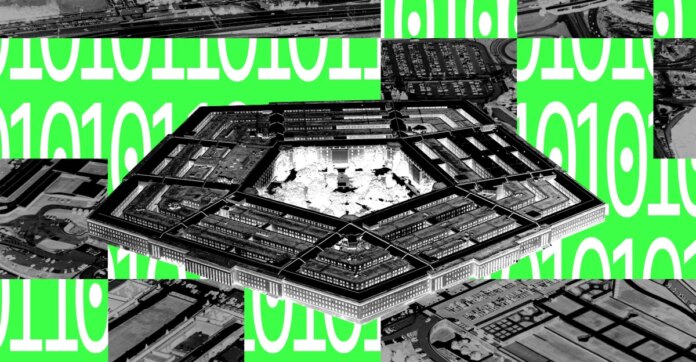

تأتي هذه الأخبار بعد أسابيع قليلة مثيرة لشركة أنثروبيك، حيث صنفت إدارة ترامب الشركة على أنها تمثل خطرًا على سلسلة التوريد – وهي تسمية مخصصة عادةً للشركات الأجنبية التي تعتبرها الحكومة خطرًا محتملاً على الأمن القومي بطريقة ما – بعد أنثروبيك. وقفت بثبات على خطين أحمرين فيما يتعلق بحالات الاستخدام المقبولة للاستخدام العسكري لتكنولوجيتها: المراقبة الجماعية المحلية والأسلحة المستقلة بالكامل (أو أنظمة الذكاء الاصطناعي التي تتمتع بالقدرة على القتل باستخدام لا مشاركة بشرية). انهارت المفاوضات، تليها الإهانات العامة و شركات الذكاء الاصطناعي الأخرى التدخل لتوقيع العقود التي تسمح “بأي استخدام قانوني” لتكنولوجيتهم.

إن تحديد مخاطر سلسلة التوريد لا يمنع شركة أنثروبيك من العمل في العقود العسكرية فحسب، بل إنه يدرج أيضًا شركات أخرى في القائمة السوداء إذا استخدمت منتجات أنثروبيك في مجال عملها لصالح البنتاغون، مما يجبرهم على اقتلاع كلود إذا كانوا يرغبون في الحفاظ على عقودهم المربحة. ومع ذلك، بما أن النموذج الأول سمح للاستخبارات السرية، فإن أدوات الأنثروبيك مدمجة بالفعل بشكل عميق في عمل البنتاغون – لدرجة أنه بعد ساعات فقط من إعلان وزير الدفاع بيت هيجسيث عن التصنيف، أفادت التقارير أن الجيش الأمريكي استخدم كلود في الحملة التي قتلت الزعيم الإيراني آية الله علي خامنئي.

يسعى ملخص صديق المحكمة إلى توضيح النقاط التي مفادها أن تصنيف مخاطر سلسلة التوريد لشركة Anthropic “يعد انتقامًا غير مناسب يضر بالمصلحة العامة” وأن المخاوف الكامنة وراء الخطوط الحمراء لشركة Anthropic “حقيقية وتتطلب استجابة”. كما يشير التقرير إلى أن الخطين الأحمرين اللذين حددتهما الأنثروبيك يستحقان إعادة النظر، حيث ينص على أن “المراقبة المحلية الجماعية المدعومة بالذكاء الاصطناعي تشكل مخاطر عميقة على الحكم الديمقراطي – حتى في الأيدي المسؤولة”، وأن “أنظمة الأسلحة الفتاكة المستقلة بالكامل تمثل مخاطر يجب معالجتها أيضًا”.

وصفت المجموعة التي تقف وراء مذكرة الصديق نفسها بأنها “مهندسون وباحثون وعلماء وغيرهم من المهنيين العاملين في مختبرات الذكاء الاصطناعي الحدودية الأمريكية”.

وكتبت المجموعة: “نحن نبني وندرب وندرس أنظمة الذكاء الاصطناعي واسعة النطاق التي تخدم مجموعة واسعة من المستخدمين وعمليات النشر، بما في ذلك المجالات ذات الصلة بالأمن القومي وإنفاذ القانون والعمليات العسكرية”. “نحن نقدم هذا الموجز ليس كمتحدثين باسم أي شركة واحدة، ولكن بصفتنا الفردية كمحترفين لديهم معرفة مباشرة بما يمكن لهذه الأنظمة أن تفعله وما لا يمكنها فعله، وما هو على المحك عندما يتجاوز نشرها الأطر القانونية والأخلاقية المصممة لحكمها.”

وعلى جبهة المراقبة الجماعية المحلية، قالت المجموعة إنه على الرغم من وجود بيانات عن المواطنين الأمريكيين في كل مكان في شكل كاميرات مراقبة، وبيانات تحديد الموقع الجغرافي، ومنشورات على وسائل التواصل الاجتماعي، والمعاملات المالية، وأكثر من ذلك، فإن “ما لا يوجد حتى الآن هو طبقة الذكاء الاصطناعي التي تحول مشهد البيانات المترامي الأطراف والمجزأ إلى جهاز مراقبة موحد في الوقت الفعلي”. وكتبوا أن تدفقات البيانات هذه معزولة في الوقت الحالي، ولكن إذا تم استخدام الذكاء الاصطناعي لربطها، فيمكنه الجمع بين “بيانات التعرف على الوجوه مع سجل المواقع، وسجلات المعاملات، والرسوم البيانية الاجتماعية، والأنماط السلوكية عبر مئات الملايين من الأشخاص في وقت واحد”.

عندما يتعلق الأمر بالأسلحة المستقلة الفتاكة على وجه التحديد، قالت المجموعة إنها يمكن أن تكون غير موثوقة في ظروف جديدة أو غير واضحة لا تتوافق مع البيئة التي تم تدريبهم فيها – مما يعني أنه “لا يمكن الوثوق بها لتحديد الأهداف بدقة تامة، كما أنها غير قادرة على إجراء المفاضلات السياقية الدقيقة بين تحقيق الهدف ومحاسبة الآثار الجانبية التي يستطيع الإنسان القيام بها”. بالإضافة إلى ذلك، كتبت المجموعة، أن قدرة أنظمة الأسلحة المستقلة الفتاكة على الهلوسة تعني أنه من المهم للبشر أن يشاركوا في عملية صنع القرار “قبل إطلاق ذخيرة فتاكة على هدف بشري” – خاصة وأن سلسلة منطق النظام غالبًا ما تكون غير متاحة للمشغلين وغير واضحة حتى لمطوري النظام.

كتبت المجموعة التي تقف وراء مذكرة الصديق: “نحن متنوعون في سياساتنا وفلسفاتنا، لكننا متحدون في الاقتناع بأن أنظمة الذكاء الاصطناعي الحدودية اليوم تشكل مخاطر عند نشرها لتمكين المراقبة الجماعية المحلية أو تشغيل أنظمة الأسلحة الفتاكة المستقلة دون إشراف بشري، وأن هذه المخاطر تتطلب نوعًا من حواجز الحماية، سواء عبر الضمانات التقنية أو قيود الاستخدام”.