لقد انخفض OpenAI تلميحات هذا الأسبوع حول دور الذكاء الاصطناعي باعتباره “حليفًا للرعاية الصحية” – واليوم تعلن الشركة عن منتج يتماشى مع هذه الفكرة: ChatGPT Health.

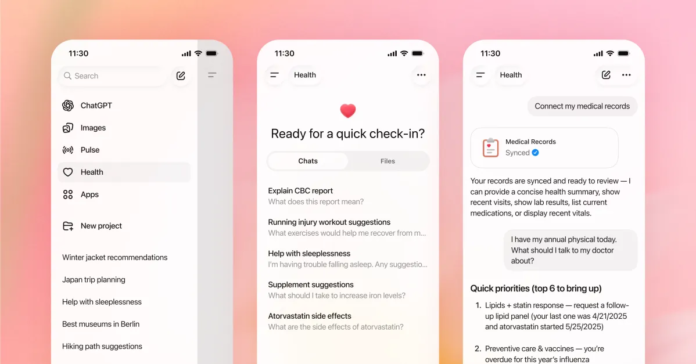

ChatGPT Health عبارة عن علامة تبويب محمية ضمن ChatGPT مصممة للمستخدمين لطرح أسئلتهم المتعلقة بصحتهم فيما تصفه ببيئة أكثر أمانًا وتخصيصًا، مع ميزة سجل الدردشة والذاكرة المنفصلة عن بقية ChatGPT. تشجع الشركة المستخدمين على ربط سجلاتهم الطبية الشخصية وتطبيقات الصحة، مثل Apple Health وPeloton وMyFitnessPal وWeight Watchers وFunction، “للحصول على إجابات أكثر تخصيصًا وثباتًا على أسئلتهم”. ويقترح ربط السجلات الطبية حتى يتمكن ChatGPT من تحليل نتائج المختبر وملخصات الزيارات والتاريخ السريري؛ MyFitnessPal وWeight Watchers للإرشاد الغذائي؛ Apple Health لبيانات الصحة واللياقة البدنية، بما في ذلك “أنماط الحركة والنوم والنشاط”؛ وظيفة للحصول على رؤى في الاختبارات المعملية.

على صعيد السجلات الطبية، تقول OpenAI إنها دخلت في شراكة مع b.well، والتي ستوفر تكاملًا خلفيًا للمستخدمين لتحميل سجلاتهم الطبية، حيث تعمل الشركة مع حوالي 2.2 مليون مقدم. في الوقت الحالي، يتطلب تطبيق ChatGPT Health من المستخدمين التسجيل للحصول على قائمة الانتظار لطلب الوصول، لأنه يبدأ بمجموعة تجريبية من المستخدمين الأوائل، ولكن سيتم طرح المنتج تدريجيًا لجميع المستخدمين بغض النظر عن مستوى الاشتراك.

تتأكد الشركة من الإشارة في منشور المدونة إلى أن ChatGPT Health “ليس مخصصًا للتشخيص أو العلاج”، لكنها لا تستطيع التحكم بشكل كامل في كيفية استخدام الأشخاص للذكاء الاصطناعي عندما يغادرون الدردشة. من قبل الشركة القبول الخاص، في المجتمعات الريفية المحرومة، يرسل المستخدمون ما يقرب من 600000 رسالة متعلقة بالرعاية الصحية أسبوعيًا، في المتوسط، وسبع من كل 10 محادثات رعاية صحية في ChatGPT “تتم خارج ساعات العمل العادية للعيادة”. في أغسطس الأطباء نشرت تقريرا في حالة رجل دخل المستشفى لأسابيع بسبب حالة طبية تعود إلى القرن الثامن عشر بعد أخذ نصيحة ChatGPT المزعومة باستبدال الملح في نظامه الغذائي ببروميد الصوديوم. تصدرت ميزة AI Overview من Google عناوين الأخبار لأسابيع بعد إطلاقها بسبب نصائح خطيرة، مثل وضع الغراء على البيتزا، وتحقيق أجراه مؤخرًا الجارديان وجد وتوالت تلك النصائح الصحية الخطيرة، مع النصائح الكاذبة الخاصة باختبارات وظائف الكبد، واختبارات سرطان النساء، والأنظمة الغذائية الموصى بها للمصابين بسرطان البنكرياس.

في منشور بالمدونة، كتبت OpenAI أنه بناءً على “التحليل غير المحدد للمحادثات”، فإن أكثر من 230 مليون شخص حول العالم يطرحون بالفعل أسئلة على ChatGPT تتعلق بالصحة والعافية كل أسبوع. وقالت OpenAI أيضًا إنها عملت على مدار العامين الماضيين مع أكثر من 260 طبيبًا لتقديم تعليقات على مخرجات النموذج أكثر من 600000 مرة في 30 مجالًا للتركيز، للمساعدة في تشكيل استجابات المنتج.

“يمكن أن يساعدك ChatGPT على فهم نتائج الاختبارات الأخيرة، أو الاستعداد للمواعيد مع طبيبك، أو الحصول على نصيحة حول كيفية التعامل مع نظامك الغذائي وروتين التمرين، أو فهم المفاضلات بين خيارات التأمين المختلفة بناءً على أنماط الرعاية الصحية الخاصة بك،” كما تدعي OpenAI في منشور المدونة.

أحد جوانب الصحة التي بدا أن شركة OpenAI تتجنب ذكرها بعناية في منشور مدونتها: الصحة العقلية. هناك عدد من الأمثلة من البالغين أو القُصَّر الذين يموتون بسبب الانتحار بعد ثقتهم في ChatGPT، وفي منشور المدونة، تمسك OpenAI بإشارة غامضة مفادها أنه يمكن للمستخدمين تخصيص التعليمات في المنتج الصحي “لتجنب ذكر المواضيع الحساسة”. عندما سئل خلال مؤتمر صحفي يوم الأربعاء عما إذا كان ChatGPT Health سيلخص أيضًا زيارات الصحة العقلية ويقدم المشورة في هذا المجال، قال فيدجي سيمو، الرئيس التنفيذي للتطبيقات في OpenAI، “إن الصحة العقلية هي بالتأكيد جزء من الصحة بشكل عام، ونحن نرى الكثير من الأشخاص يلجأون إلى ChatGPT لإجراء محادثات الصحة العقلية”، مضيفًا أن المنتج الجديد “يمكنه التعامل مع أي جزء من صحتك بما في ذلك الصحة العقلية … نحن نركز بشدة على التأكد من أننا في حالات الضيق نستجيب وفقًا لذلك ونوجه نحو المتخصصين في مجال الصحة أيضًا”. كأحباء أو موارد أخرى.

من الممكن أيضًا أن يؤدي المنتج إلى تفاقم حالات القلق الصحي، مثل المراق. عندما سُئل عما إذا كانت OpenAI قد قدمت أي ضمانات للمساعدة في منع الأشخاص الذين يعانون من مثل هذه الحالات من التفاقم أثناء استخدام ChatGPT Health، قال سيمو: “لقد قمنا بالكثير من العمل على ضبط النموذج للتأكد من أننا مطلعون دون أن نكون مثيرين للقلق على الإطلاق، وأنه إذا كان هناك إجراء يجب اتخاذه، فإننا نوجهه إلى نظام الرعاية الصحية”.

عندما يتعلق الأمر بالمخاوف الأمنية، تقول OpenAI أن ChatGPT Health “تعمل كمساحة منفصلة ذات خصوصية معززة لحماية البيانات الحساسة” وأن الشركة قدمت عدة طبقات من التشفير المصمم لهذا الغرض (ولكن ليس التشفير الشامل)، وفقًا للإحاطة الإعلامية. لا يتم استخدام المحادثات داخل المنتج الصحي لتدريب النماذج الأساسية الخاصة به، بشكل افتراضي، وإذا بدأ المستخدم محادثة متعلقة بالصحة في ChatGPT العادي، فسوف يقترح برنامج الدردشة الآلي نقلها إلى المنتج الصحي للحصول على “حماية إضافية”، وفقًا لمنشور المدونة. لكن OpenAI تعرضت لخروقات أمنية في الماضي، أبرزها أ مارس 2023 المشكلة التي سمحت لبعض المستخدمين برؤية عناوين الدردشة والرسائل الأولية والأسماء وعناوين البريد الإلكتروني ومعلومات الدفع من مستخدمين آخرين. وفي حالة صدور أمر من المحكمة، ستظل OpenAI بحاجة إلى توفير الوصول إلى البيانات “حيثما يكون ذلك مطلوبًا من خلال عمليات قانونية صالحة أو في حالة الطوارئ”، حسبما قال رئيس الصحة في OpenAI Nate Gross خلال المؤتمر الصحفي.

عندما سُئل عما إذا كانت ChatGPT Health متوافقة مع قانون قابلية نقل التأمين الصحي والمساءلة (HIPAA)، قال جروس إنه “في حالة المنتجات الاستهلاكية، لا ينطبق قانون HIPAA في هذا الإعداد – فهو ينطبق على إعدادات الرعاية الصحية السريرية أو المهنية.”